سری پردازندههای گرافیکی Instinct AMD در جامعه محاسباتی و هوش مصنوعی محبوب شده است. در اینجا دلیل آن است.

شکی نیست که NVIDIA همچنان با سری های مختلف GPU محبوب خود بر فضای محاسبات موازی تسلط دارد. اما با تجهیز شتابدهندههای هوش مصنوعی Instinct AMD که دو تا از جدیدترین و بزرگترین ابررایانهها (Frontier و El Capitan) را تجهیز میکنند و حمایت روزافزون جامعه از پلتفرم منبع باز ROCm آنها، NVIDIA ممکن است بزرگترین رقیب خود را پیدا کند.

بنابراین، شتابدهندههای هوش مصنوعی Instinct AMD دقیقاً چه هستند؟ چه چیزی آنها را قدرتمند می کند و چگونه با پردازنده های گرافیکی Tensor NVIDIA مقایسه می شوند؟

پردازنده AMD Instinct چیست؟

پردازندههای Instinct AMD سختافزاری در سطح سازمانی هستند که برای محاسبات با عملکرد بالا (HPC) و پردازشهای شتابدهی هوش مصنوعی استفاده میشوند. برخلاف پردازندههای گرافیکی معمولی و درجه یک مصرفکننده، پردازندههای گرافیکی Instinct برای انجام بهتر یادگیری هوش مصنوعی و سایر وظایف با کارایی بالا از طریق نوآوریهای نرمافزاری و سختافزاری تخصصی هستند.

از سری پردازندههای گرافیکی AMD Instinct برای تامین انرژی اولین ابررایانه برای شکستن سد Exascale استفاده شد که با سرعت 1.1 EFLOP با عملیات با دقت دو برابر در ثانیه انجام شد. ابررایانههایی که از پردازندههای گرافیکی Instinct استفاده میکنند در حال حاضر برای تحقیق در مورد درمان سرطان، انرژی پایدار و تغییرات آب و هوایی استفاده میشوند.

چگونه پردازنده های غریزی هوش مصنوعی و HPC را تسریع می کنند؟

برای اینکه قدرتمندترین سرورها و ابررایانههای اصلی جهان به پردازش در سطح Exascale دست یابند، شتابدهندههای Instinct AMD باید به چندین ارتقاء و نوآوری فناوری مجهز میشدند.

بیایید برخی از فناوری های جدید و به روز مورد استفاده در پردازنده های گرافیکی AMD Instinct را مورد بحث قرار دهیم.

1. محاسبه DNA (CDNA)

شتاب دهنده های اخیر AMD Instinct (که از MI100 شروع می شود) از معماری CDNA این شرکت استفاده کرده اند.

CDNA در درجه اول بر روی ویژگی هایی مانند پردازش موازی، سلسله مراتب حافظه و عملکردهای محاسباتی بهینه از طریق فناوری Matrix Core تمرکز دارد. حتی HPC و AI یا یادگیری ماشینی که روی سرورهای منفرد اجرا میشود، میتواند توسط CDNA و همچنین رایانههای بزرگ Exascale پشتیبانی شود.

فناوری Matrix Core AMD با پشتیبانی از عملیات با دقت ترکیبی، یادگیری هوش مصنوعی را تسریع می کند. توانایی محاسبه با دقت های مختلف به GPU های Instinct اجازه می دهد تا به طور موثر عملیات ماتریس را بر اساس سطح دقت مورد نیاز محاسبه کنند.

محبوب ترین فرمت های محاسباتی دقیق عبارتند از FP64، FP32، FP16، BF16، و INT8. FP مخفف Floating Point، BF برای Brain Floating Point و INT برای Integer است. هرچه عدد مربوط به قالب بیشتر باشد، محاسبه دقیق تر است. عملکرد در 64 بیت به عنوان دقت دوگانه شناخته می شود. با 32 بیت، تک دقیق، 16 بیت نیمه دقیق، و غیره.

از آنجایی که بخش بزرگی از آموزش مدلهای یادگیری عمیق به دقت زیادی نیاز ندارد، داشتن توانایی محاسبه عملیات ماتریس با دقت نیمه یا حتی یک چهارم دقت برای استنباط، حجم کار را به میزان قابل توجهی کاهش میدهد و در نتیجه یادگیری هوش مصنوعی را تسریع میکند.

2. حافظه با پهنای باند بالا (HBM)

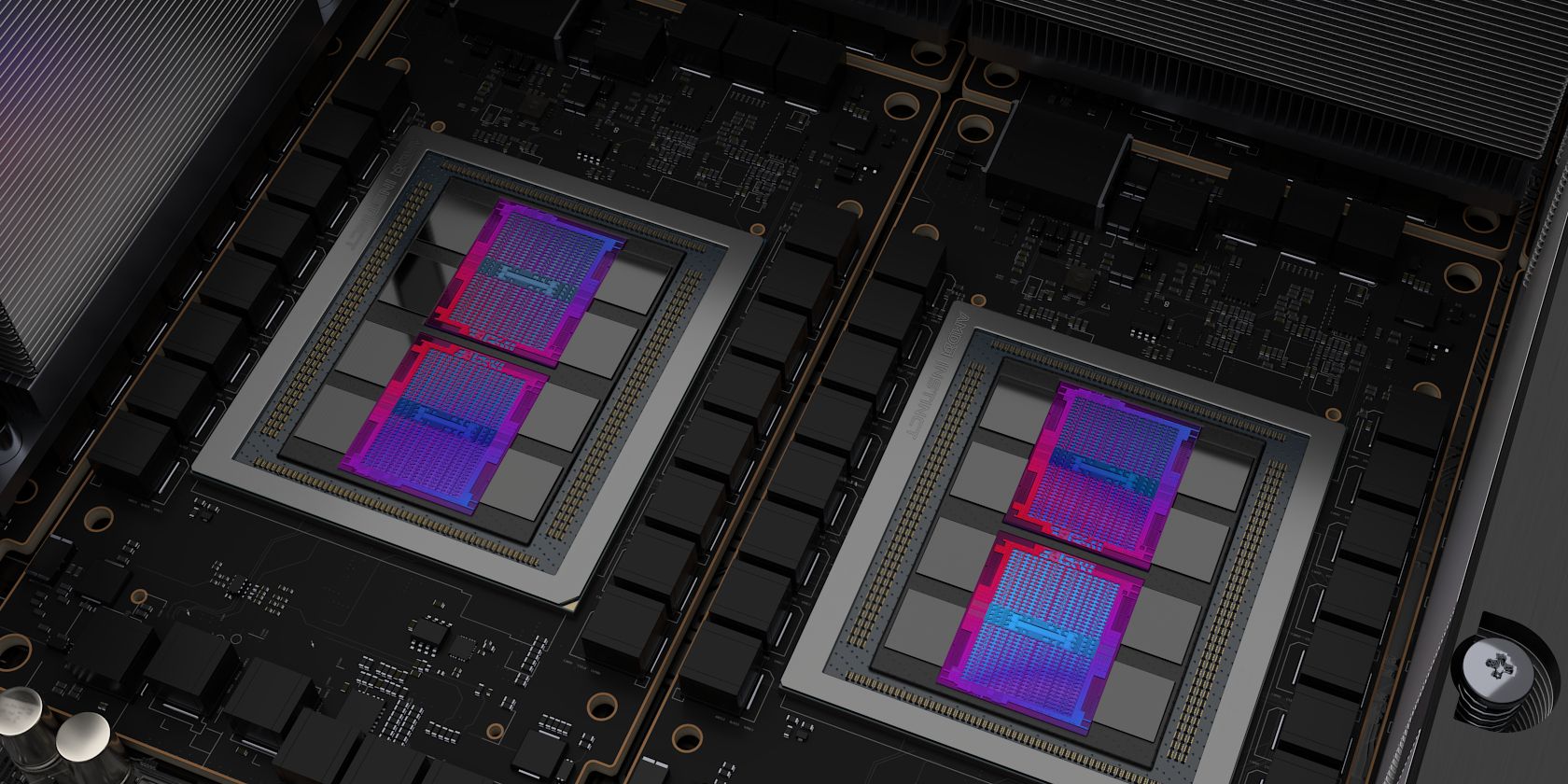

هر شتاب دهنده هوش مصنوعی AMD Instinct دارای حداکثر 880 هسته ماتریکس است. با پردازنده های Matrix Core AMD که قادر به انجام 383 TFLOP محاسبات نیمه دقیق هستند، داشتن حافظه فوق سریع ضروری است. جدیدترین پیشنهادات Instinct AMD به جای رم معمولی DDR4 یا DDR5 به حافظه با پهنای باند بالا (HBM) مجهز شده است.

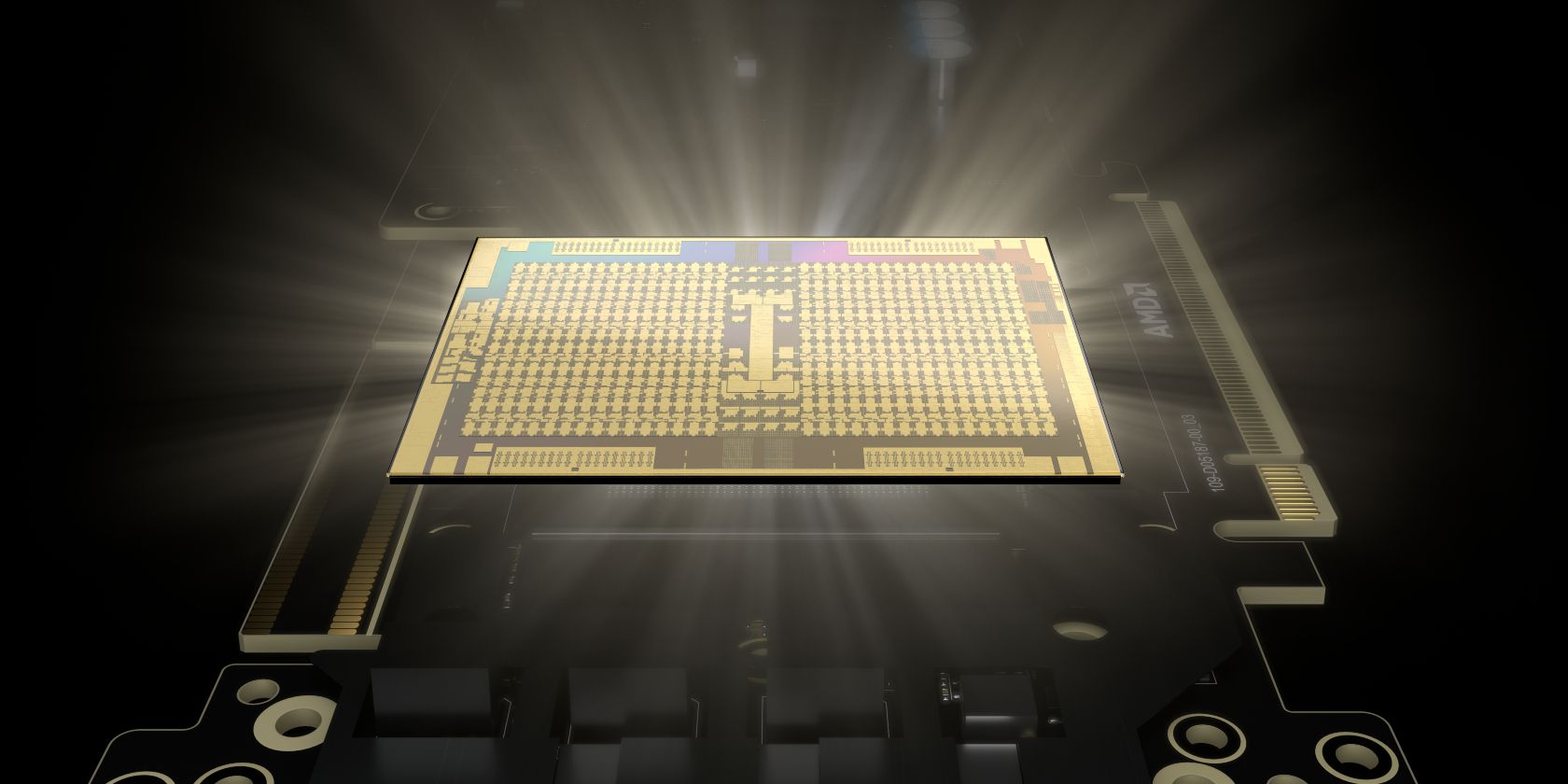

بر خلاف حافظه های معمولی، HBM از آنچه به عنوان معماری انباشته سه بعدی شناخته می شود استفاده می کند. این نوع معماری به یک رویکرد طراحی اشاره دارد که در آن قالب های DRAM به صورت عمودی روی هم قرار می گیرند. این اجازه می دهد تا قالب ها در هر دو محور عمودی و افقی روی هم چیده شوند، از این رو اصطلاح انباشتگی سه بعدی نامیده می شود.

با این فناوری انباشته سه بعدی، HBM ها می توانند ظرفیت حافظه فیزیکی به اندازه چند صد گیگابایت در هر ماژول داشته باشند، در حالی که DRR5 تنها می تواند تا ده ها گیگابایت در هر ماژول را انجام دهد. علاوه بر ظرفیت، HBM ها همچنین از نظر سرعت انتقال و بازده انرژی بهتری نسبت به حافظه های DDR معمولی دارند.

3. پارچه بی نهایت

یکی دیگر از نوآوریهای موجود در پردازندههای گرافیکی Instinct، فناوری Infinity Fabric AMD است. Infinity Fabric نوعی سیستم اتصال است که CPU و GPU را به روشی پویا هوشمند به هم متصل می کند. این اجازه می دهد تا اجزا به طور موثر با یکدیگر ارتباط برقرار کنند.

با Infinity Fabric، به جای اتصال اجزا با یک گذرگاه معمولی، اجزا در حال حاضر در یک شبکه مش مانند متصل می شوند که پهنای باند آن می تواند تا چند صد گیگابایت در ثانیه باشد.

جدا از اتصال شبکه مانند، Infinity Fabric همچنین از حسگرهای تعبیه شده در هر قالب برای کنترل پویا فرکانس، نرخ انتقال داده و سایر رفتارهای تطبیقی، بهینه سازی عملکرد و به حداقل رساندن تأخیر استفاده می کند.

4. بستر توسعه ROCm

CUDA NVIDIA (معماری یکپارچه دستگاه محاسبه) پرکاربردترین پلت فرم توسعه برای آموزش مدل های هوش مصنوعی است. مشکل CUDA این است که فقط با پردازنده های گرافیکی NVIDIA کار می کند. این یکی از دلایل اصلی این است که NVIDIA اکثریت قریب به اتفاق سهم بازار را برای شتاب دهنده های HPC و AI GPU دارد.

با توجه به اینکه AMD میخواهد بخش بزرگتری از بازار HPC و هوش مصنوعی به دست آورد، باید پلتفرم خود را به نام ROCm (Radeon Open Compute) توسعه دهد. ROCm یک پلت فرم نرم افزار منبع باز است که به GPU های Instinct اجازه می دهد تا به عنوان شتاب دهنده های هوش مصنوعی استفاده شوند.

اگرچه لزوماً بخشی از سختافزار Instinct نیست، اما ROCm در مورد بقای سری پردازندههای گرافیکی Instinct اساسی است. با ROCm، توسعهدهندگان و محققان ابزارهای ROCm، کامپایلر، درایورهای هسته، مجموعهای از کتابخانهها و دسترسی به چارچوبهایی مانند TensorFlow و PyTorch را برای توسعه با زبان برنامهنویسی AI ترجیحی خود دریافت میکنند.

چگونه شتاب دهنده های هوش مصنوعی Instinct با شتاب دهنده های هوش مصنوعی Radeon GPU مقایسه می شوند؟

AMD مجموعه پردازنده های گرافیکی Instinct خود را برای سازمانی و پردازنده های گرافیکی Radeon را برای مصرف کنندگان معمولی ارائه می دهد. همانطور که قبلاً گفته شد، GPU Instinct از معماری CDNA، HBM و Infinity Fabric AMD استفاده می کند. برعکس، Radeon از معماری RDNA AMD، حافظه DDR6 و Infinity Cache استفاده می کند.

اگرچه توانایی کمتری دارد، اما سری شتابدهندههای هوش مصنوعی Radeon همچنان دارای یک یا دو هسته شتابدهنده هوش مصنوعی در هر واحد محاسباتی هستند. آخرین پردازنده گرافیکی Radeon RX7900 XT دارای دو هسته شتابدهنده هوش مصنوعی در هر واحد محاسباتی است که اجازه میدهد 103 ترافلاپس حداکثر نیمه دقیق و 52 ترافلاپس پیک محاسبات تک دقیق را انجام دهد.

در حالی که سری پردازندههای گرافیکی Instinct برای LLM و HPC مناسبتر هستند، شتابدهندههای هوش مصنوعی Radeon میتوانند برای تنظیم دقیق مدلهای از پیش آموزشدیده، استنتاج، و کارهای گرافیکی فشرده استفاده شوند.

AMD Instinct در مقابل NVIDIA Tensor

طبق نظرسنجی TrendForce، NVIDA 80 درصد از سهم بازار پردازندههای گرافیکی سرور را در اختیار دارد، در حالی که AMD تنها 20 درصد از بازار را در اختیار دارد. این موفقیت چشمگیر از NVIDIA به این دلیل است که آنها یک شرکت متخصص در طراحی و مونتاژ GPU هستند. این به آنها اجازه میدهد تا پردازندههای گرافیکی با عملکرد قابلتوجهی بهتر طراحی کنند که با سایر ارائهها بینظیر است.

بیایید AMD Instinct MI205X و NVIDIA’s H100SXM5 را با استفاده از مشخصات وب سایت رسمی AMD و دیتاشیت خود NVIDIA مقایسه کنیم:

مدل GPU

FP64 (TFLOP)

FP32 (TFLOP)

FP16 (TFLOP)

INT8 (TFLOP)

AMD Instinct MI250X

30.0

60.0

1000

2000

NVIDIA H100 SXM

47.9

95.7

383.2

383

همانطور که در جدول مشاهده می کنید، MI250X AMD از نظر محاسبات با دقت دو برابر و نیمه دقیق عملکرد بهتری دارد، در حالی که H100SXMS NVIDIA از نظر محاسبات ماتریس با دقت نیمه دقیق و یک چهارم دقت به مراتب بهتر است. این باعث می شود MI250X AMD برای HPC مناسب تر باشد در حالی که NVIDIA H100SXMS با یادگیری و استنباط AI.

آینده پردازنده های غریزی AMD

اگرچه آخرین پیشنهاد AMD، MI250X، برای HPC طراحی شده است، MI300 آینده آنها بیشتر مبتنی بر آموزش هوش مصنوعی است. این شتاب دهنده هوش مصنوعی یک APU اعلام شده است که GPU و CPU را در یک بسته ترکیب می کند. این به MI300 اجازه می دهد تا از معماری CNDA3 Unified Memory APU خود استفاده کند، جایی که GPU و CPU فقط از یک حافظه استفاده می کنند و باعث افزایش کارایی و کاهش قیمت می شود.

اگرچه AMD امروز در بازار شتابدهندههای هوش مصنوعی با NVIDIA رقابت نمیکند، به محض اینکه MI300 عرضه شد و ROCm صیقلی شد، سری Instinct AMD ممکن است به اندازه کافی خوب باشد تا بخش قابل توجهی از بازار شتابدهندههای هوش مصنوعی را از NVIDIA ربوده باشد.