آیا هوش مصنوعی به نفع ما خیلی سریع حرکت می کند؟

جدیدترین نوآوریها در زمینه فناوری مبتنی بر هوش مصنوعی، مرزهای آنچه را که زمانی فکر میکردیم با هوش مصنوعی امکانپذیر است را جابجا میکند. با این حال، با توجه به اینکه چت رباتهایی مانند ChatGPT و Bing Chat در چندین کار تقریباً به خوبی انسانها عمل میکنند، آیا زمان آن رسیده است که برای مدتی ترمز کنید؟

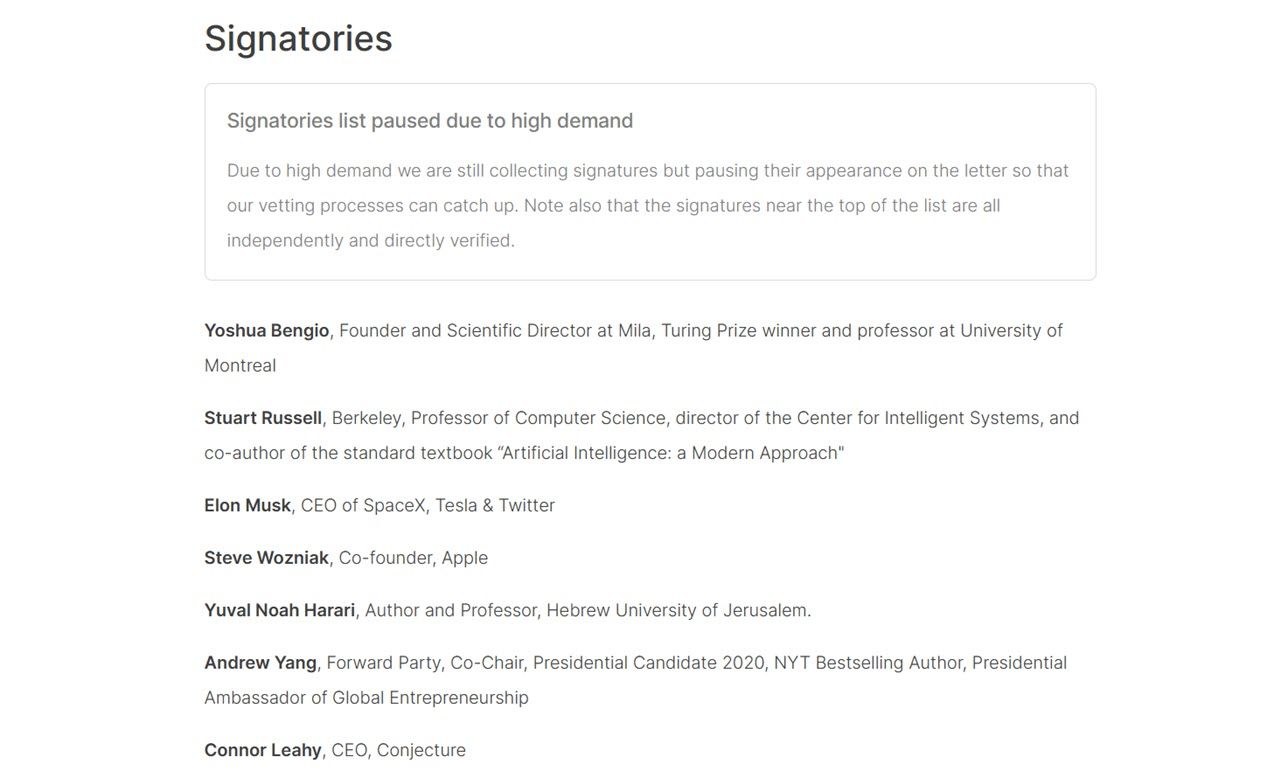

ایلان ماسک و چندین محقق هوش مصنوعی از جمله 1188 نفری هستند که (در زمان نگارش مقاله) چنین فکر می کنند. نامهای که توسط موسسه غیرانتفاعی Future of Life منتشر شده است، خواستار توقف شش ماهه آموزش فناوریهای هوش مصنوعی بهتر از GPT 4 شده است، اما آیا واقعاً مکث لازم است؟

نامه سرگشاده آینده زندگی چیست؟

نامه منتشر شده توسط مؤسسه Future of Life اشاره میکند که آزمایشگاههای هوش مصنوعی برای توسعه و استقرار هر چه بیشتر مدلهای هوش مصنوعی که هیچکس، از جمله سازندگان آنها، نمیتوانند آنها را بفهمند، پیشبینی کنند، «در یک مسابقه خارج از کنترل قفل شدهاند». ، یا به طور قابل اعتماد کنترل کنید”.

همچنین اشاره میکند که سیستمهای هوش مصنوعی معاصر اکنون در حال تبدیل شدن به رقابت برای انسان در وظایف عمومی هستند و میپرسد که آیا باید “ذهن غیرانسانی را توسعه دهیم که ممکن است در نهایت از تعداد، پیشی گرفته، منسوخ شده و جایگزین ما شود”.

این نامه در نهایت از همه آزمایشگاههای هوش مصنوعی میخواهد که بلافاصله آموزش سیستمهای هوش مصنوعی قدرتمندتر از GPT-4 را برای حداقل شش ماه متوقف کنند. مکث باید عمومی و قابل تأیید در همه بازیگران کلیدی نیز باشد. همچنین بیان میکند که اگر چنین مکثی نمیتواند به سرعت اجرا شود، دولتها باید برای ممنوع کردن موقت آموزش مدلهای هوش مصنوعی وارد عمل شوند.

هنگامی که مکث فعال شد، از آزمایشگاههای هوش مصنوعی و کارشناسان مستقل خواسته میشود تا از آن برای توسعه و پیادهسازی مشترک «مجموعهای از پروتکلهای امنیتی مشترک» استفاده کنند تا اطمینان حاصل شود که سیستمهایی که به این قوانین پایبند هستند، «فراتر از شک منطقی ایمن هستند».

این نامه توسط افراد زیادی از جمله ایلان ماسک، استیو وزنیاک و محققان و نویسندگان هوش مصنوعی امضا شده است. در واقع، لیست امضاکنندگان به دلیل تقاضای زیاد در حال حاضر متوقف شده است.

نگرانی ماسک با فناوری هوش مصنوعی پیشرفته و OpenAI چیست؟

در حالی که امضای نامه Future of Life ممکن است نشان دهنده این باشد که ماسک در مورد خطرات ایمنی چنین سیستم های پیشرفته هوش مصنوعی نگران است، دلیل واقعی ممکن است چیز دیگری باشد.

ماسک در سال 2015 بهعنوان یک سازمان غیرانتفاعی OpenAI را با مدیر عامل فعلی سام آلتمن تأسیس کرد. با این حال، او بعداً در سال 2018 پس از اینکه متوجه شد از پیشرفت شرکت راضی نیست، با آلتمن مخالفت کرد. گزارش شده است که ماسک می خواست برای سرعت بخشیدن به توسعه، مسئولیت را بر عهده بگیرد، اما آلتمن و هیئت مدیره OpenAI این ایده را کنار گذاشتند.

ماسک مدت کوتاهی بعد از OpenAI کنار رفت و پول خود را با خود برد و قول خود را مبنی بر کمک 1 میلیاردی کمک مالی کرد و فقط 100 میلیون قبل از ترک آن پرداخت. این امر باعث شد که OpenAI کمی بعد در مارس 2019 به یک شرکت خصوصی تبدیل شود تا برای ادامه تحقیقات خود بودجه جمع آوری کند.

دلیل دیگری که ماسک را ترک کرد این بود که توسعه هوش مصنوعی در تسلا باعث تضاد منافع در آینده خواهد شد. واضح است که تسلا به سیستمهای هوش مصنوعی پیشرفته نیاز دارد تا ویژگیهای خودران کامل خود را تقویت کند. از زمانی که ماسک OpenAI را ترک کرد، این شرکت با مدلهای هوش مصنوعی خود فرار کرد و ChatGPT مجهز به GPT3.5 را در سال 2022 راهاندازی کرد و بعداً GPT-4 را در مارس 2023 دنبال کرد.

این واقعیت که تیم هوش مصنوعی ماسک به هیچ وجه به OpenAI نزدیک نیست، باید هر بار که او میگوید مدلهای هوش مصنوعی مدرن میتوانند خطراتی را ایجاد کنند، مورد بررسی قرار گیرد. او همچنین در راه اندازی نسخه بتای خودران کامل تسلا در جاده های عمومی هیچ مشکلی نداشت و اساساً رانندگان معمولی تسلا را به آزمایش کننده های بتا تبدیل کرد.

این هم به اینجا ختم نمی شود. ماسک همچنین نسبتاً از OpenAI در توییتر انتقاد کرده است و آلتمن تا آنجا پیش رفت که گفت که او در حالی که اخیراً در پادکست “On with Kara Swisher” ظاهر می شود به آنها حمله می کند.

در حال حاضر، به نظر می رسد که ماسک فقط از نامه آینده زندگی استفاده می کند تا توسعه در OpenAI و هر شرکت دیگری را که به GPT-4 برسد را متوقف کند تا به شرکت های خود فرصتی دهد تا به جای نگرانی در مورد خطرات احتمالی این موضوع، فرصتی برای عقب نشینی داشته باشند. ژست مدل های هوش مصنوعی توجه داشته باشید که این نامه همچنین خواستار توقف “آموزش” سیستم های هوش مصنوعی به مدت شش ماه است که می توان نسبتاً به راحتی از کنار گذاشتن آن برای ادامه توسعه آنها در این مدت گذشت.

آیا واقعاً یک مکث لازم است؟

ضرورت توقف به وضعیت مدلهای هوش مصنوعی در آینده بستگی دارد. این نامه قطعاً لحن کمی دراماتیک دارد و ما خطر از دست دادن کنترل تمدن خود را به هوش مصنوعی نداریم، همانطور که آشکارا بیان می کند. با این حال، فناوریهای هوش مصنوعی چند تهدید ایجاد میکنند.

با توجه به اینکه OpenAI و سایر آزمایشگاههای هوش مصنوعی میتوانند بررسیهای ایمنی بهتری را ارائه دهند، مکث بیشتر از اینکه فایده داشته باشد، ضرر دارد. با این حال، پیشنهاد نامه در مورد مجموعه ای از پروتکل های ایمنی مشترک که “به شدت توسط کارشناسان مستقل خارجی بررسی و نظارت می شوند” ایده خوبی به نظر می رسد.

با توجه به اینکه غولهای فناوری مانند گوگل و مایکروسافت میلیاردها دلار برای توسعه و ادغام هوش مصنوعی در محصولات خود سرمایهگذاری میکنند، بعید است که این نامه بر سرعت فعلی توسعه هوش مصنوعی تأثیر بگذارد.

هوش مصنوعی اینجاست تا بماند

با توجه به اینکه غولهای فناوری ادغام هوش مصنوعی در محصولات خود را بیشتر میکنند و میلیاردها دلار برای تحقیق و توسعه سرمایهگذاری میکنند، هوش مصنوعی بدون توجه به آنچه مخالفان میگویند، اینجاست.

اما این ایده بدی نیست که اقدامات ایمنی را برای جلوگیری از خارج شدن این فناوری ها از ریل و تبدیل شدن بالقوه به ابزارهایی برای آسیب، اجرا کنید.