شبیه سازی صدای هوش مصنوعی فوق العاده آسان است و می توان از آن برای دستکاری عزیزانتان استفاده کرد.

خلاصه عناوین

- کلاهبرداری شبیه سازی صوتی هوش مصنوعی چگونه کار می کند؟

- چرا کلاهبرداری های شبیه سازی صوتی با هوش مصنوعی بسیار موثر هستند؟

- نشانه های کلیدی کلاهبرداری شبیه سازی صوتی با هوش مصنوعی

- اگر مشکوک به کلاهبرداری شبیه سازی صوتی با هوش مصنوعی هستید چه باید کرد؟

- پیشگیری بهترین دفاع در برابر کلاهبرداری های شبیه سازی صوتی هوش مصنوعی است

تعاریف کلیدی

- کلاهبرداری شبیه سازی صدا از هوش مصنوعی برای تکرار صداها به طور واقعی استفاده می کند و احساسات و فوریت ها را به دام می اندازد.

- کلاهبرداران از داده های رسانه های اجتماعی برای ایجاد سناریوهای قابل باور و سوء استفاده از پیوندهای شخصی استفاده می کنند.

- محتاط باشید و پرچم قرمز کلاهبرداری های شبیه سازی صوتی هوش مصنوعی را یاد بگیرید. تماس ها را قطع کنید و پیام های ناراحتی را تأیید کنید.

آخر شب است. والدینتان پیامی صوتی از شما دریافت می کنند که پر از وحشت است، مبنی بر اینکه در مشکل هستید، کیف پول شما دزدیده شده است و شما در میان ناکجاآباد گیر کرده اید. پول باید فوراً به شما سیم کشی شود تا بتوانید به خانه برگردید.

صدای موجود در پیام بسیار واقعی به نظر می رسد و بی تردید صدای فرزند آنهاست – اما اینطور نیست. این یک شبیهسازی صوتی هوش مصنوعی است، و آنها هدف کلاهبرداریهایی قرار گرفتهاند که به همان اندازه که بهشدت مؤثر است، پیشرفته هستند.

کلاهبرداری شبیه سازی صوتی هوش مصنوعی چگونه کار می کند؟

شبیه سازی صدا می تواند کپی های دیجیتالی فوق العاده واقعی از صدای یک فرد ایجاد کند. این تکنیک که معمولاً دیپفیک صوتی نامیده میشود، با ابزارهای شبیهسازی صدای هوش مصنوعی مانند ElevenLabs ایجاد میشود (نمونه شبیهسازی صوتی هوش مصنوعی در زیر را بررسی کنید). همراه با هوش مصنوعی و سنتز صدا، صدای شبیه سازی شده می تواند احساسات، تفاوت های ظریف، لحن و حتی ترس را تکرار کند.

و به عنوان مرجع، در اینجا این است که چگونه کریستین کاولی واقعاً در پادکست واقعا مفید صحبت می کند.

برای ایجاد یک کلون صوتی هوش مصنوعی، فقط یک نمونه صدای کوچک مورد نیاز است – اغلب فقط یک دقیقه یا کمتر. نمونههایی از صداها اغلب از پستهای رسانههای اجتماعی عمومی گرفته میشوند، و بلاگرهای ویدئویی و اینفلوئنسرها را آسیبپذیر میسازد، زیرا کیفیت صوتی پستهای آنها با کیفیت بالا و به راحتی در دسترس است.

هنگامی که کلاهبرداران نمونه صدا را شبیه سازی می کنند، از تبدیل متن به گفتار یا حتی گفتار به گفتار در زمان واقعی برای ایجاد تماس ها و پیام های صوتی جعلی استفاده می کنند.

کلاهبردار با دسترسی به رسانههای اجتماعی قربانی و جمعآوری اطلاعات شخصی او، سناریویی باورپذیر ایجاد میکند. این می تواند بستری شدن، دستگیری، سرقت، آدم ربایی باشد – هر چیزی که ترس ایجاد کند. سپس از صدای شبیهسازیشده برای دستکاری یکی از اعضای خانواده استفاده میشود تا باور کند که یکی از عزیزان در مشکل جدی است.

واقع گرایی صدا و احساسات، همراه با شوک و فوریت درخواست، می تواند بر شک و تردید غلبه کند و منجر به تصمیمات عجولانه برای انتقال پول یا ارائه اطلاعات حساس شود.

چرا کلاهبرداری های شبیه سازی صوتی با هوش مصنوعی بسیار موثر هستند؟

مانند اکثر کلاهبرداری هایی که خانواده و دوستان را هدف قرار می دهند، کلاهبرداری شبیه سازی صوتی هوش مصنوعی به دلیل سوء استفاده از پیوندهای شخصی مؤثر است. وحشت ناشی از دریافت تماس پریشانی از سوی یکی از عزیزان میتواند به سرعت قضاوت را مختل کند و در نتیجه تصمیمهای عجولانه بگیرد. این همان تاکتیکی است که در کلاهبرداری های quid pro استفاده می شود، اما تأثیر آن با شنیدن صدای یکی از نزدیکان شما بیشتر می شود.

اعضای خانواده افرادی که حضور بالایی در رسانه های اجتماعی دارند یا کسانی که در سفر هستند به ویژه در معرض خطر هستند زیرا موقعیت آنها زمینه قابل قبولی برای روایت ساختگی کلاهبردار فراهم می کند. کلاهبرداران اغلب دادههای خصوصی اهداف خود را از حسابهای رسانههای اجتماعی که در معرض دید عموم قرار میدهند، زودتر جمعآوری کرده و از آنها استفاده میکنند و داستانها را قانعکنندهتر میکنند.

نشانه های کلیدی کلاهبرداری شبیه سازی صوتی با هوش مصنوعی

با وجود پیچیدگی، کلاهبرداری های شبیه سازی صوتی هوش مصنوعی می توانند خود را از طریق پرچم های قرمز خاص نشان دهند:

- فوریت: کلاهبردار شما را متقاعد می کند که اگر فورا اقدامی انجام نشود، اتفاق وحشتناکی رخ خواهد داد.

- حقایق: کلاهبرداران همیشه داستان کامل رابطه شما با هدف را نمی دانند، بنابراین به ناهماهنگی ها توجه کنید.

- درخواستهای غیرمعمول: درخواست انتقال پول به حسابهای بانکی خارج از کشور یا پرداخت به کیف پول رمزنگاری تاکتیکهای رایج هستند.

در نظر گرفتن این عوامل در هنگام ارائه یک سناریوی وحشتناک دشوار است، اما می تواند مانع از کلاهبرداری شما شود.

اگر مشکوک به کلاهبرداری شبیه سازی صوتی با هوش مصنوعی هستید چه باید کرد؟

اگر تماس یا پیام صوتی از عزیزانتان در مضیقه دریافت کردید، آرام باشید. کلاهبرداران برای وحشت و احساساتی شدن به شما متکی هستند، زیرا این آسیب پذیری شما را در برابر تاکتیک های آنها افزایش می دهد.

اگر تماس تلفنی دریافت کردید

اگر حتی برای یک ثانیه مشکوک هستید که یک تماس ممکن است یک کلاهبرداری شبیه سازی صوتی باشد، بلافاصله تماس را قطع کنید. هیچ اطلاعاتی را به اشتراک نگذارید و با کلاهبرداران درگیر نشوید. در عوض، برای تأیید صحت تماس پریشان با یک شماره شناخته شده با عزیزتان تماس بگیرید.

مکالمه بیشتر با کلاهبرداران می تواند خطر ضبط و شبیه سازی صدای شما را نیز به همراه داشته باشد.

اگر پیام صوتی دریافت کردید

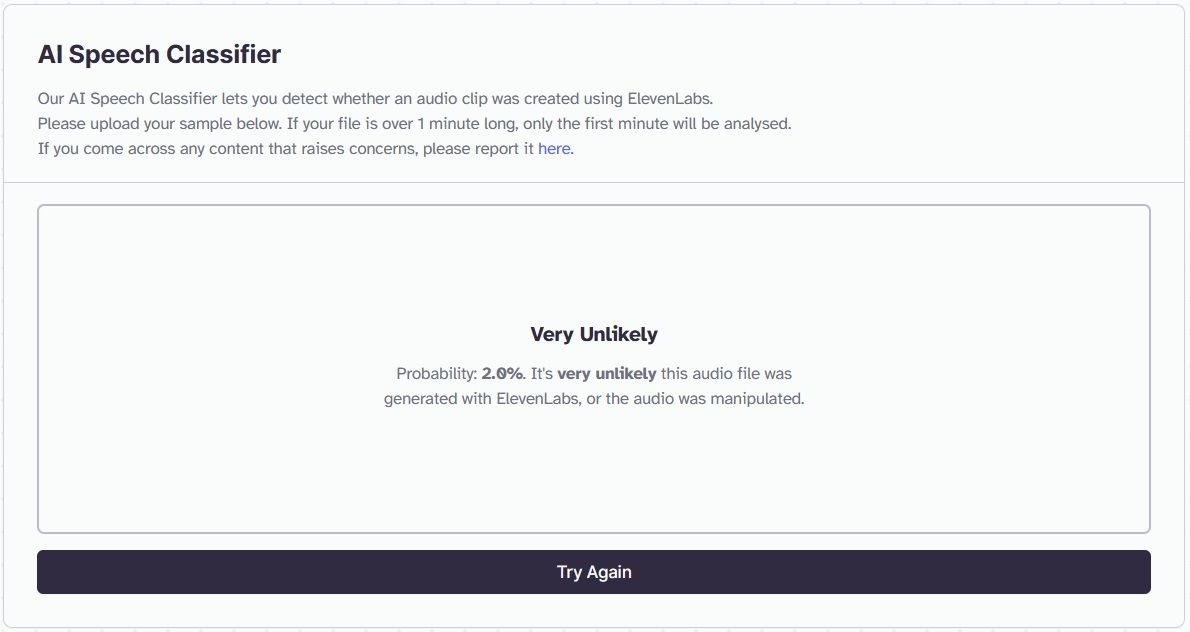

اگر کلاهبرداران پیام صوتی گذاشته اند، فوراً صدا را در تلفن یا لپ تاپ خود ذخیره کنید. این نمونه صدا را می توان در ابزار طبقه بندی گفتار هوش مصنوعی برای تعیین اینکه آیا صدای انسان است استفاده کرد. این طبقهبندیکنندههای گفتار هوش مصنوعی درست مانند آشکارسازهای نوشتن هوش مصنوعی کار میکنند. به سادگی فایل صوتی را وارد کنید و طبقه بندی کننده آن را به عنوان تولید شده توسط انسان یا هوش مصنوعی علامت گذاری می کند.

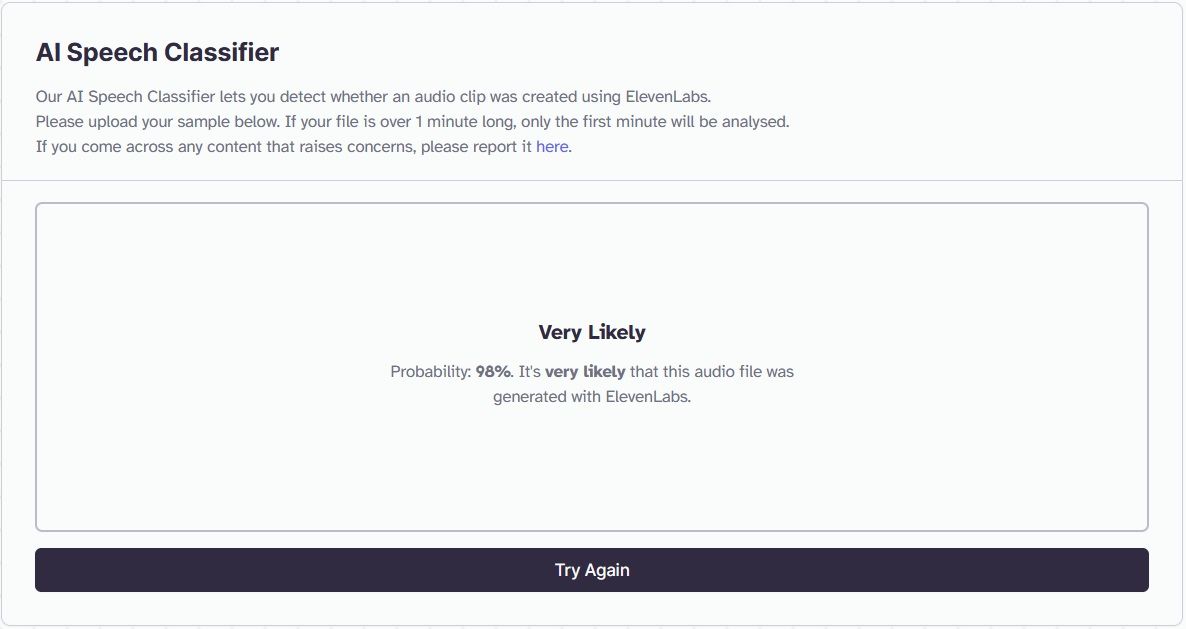

یک ابزار عالی برای انجام این بررسی، طبقهبندی کننده گفتار ElevenLabs است. ElevenLabs قدرت اکثر پلتفرم های شبیه سازی هوش مصنوعی را دارد، بنابراین ابزاری ایده آل برای تعیین اینکه آیا یک صدا شبیه سازی شده است یا خیر. در اینجا نحوه استفاده از آن برای تعیین صدای شبیه سازی شده با هوش مصنوعی آورده شده است:

- به طبقهبندی کننده گفتار ElevenLabs بروید.

- نمونه ای از پیام صوتی را بارگذاری کنید و روی “تشخیص گفتار ترکیبی” کلیک کنید.

در مثال زیر، یک پیام ناراحت کننده توسط یک انسان ضبط شده و در طبقه بندی کننده آپلود شده است. می توانید ببینید که به احتمال 2% دستکاری شده است.

در مثال بعدی، همان پیام ناراحت کننده با ابزار شبیه سازی صوتی هوش مصنوعی تولید شد. برای گوش انسان، صداها قابل تشخیص نیستند. با این حال، این ابزار آن را با احتمال 98 درصدی برای تولید هوش مصنوعی مشخص کرده است.

در حالی که نمیتوانید 100% به این طبقهبندیکننده تکیه کنید، میتواند ظن شما را در مورد استفاده از صدای شبیهسازیشده تأیید کند. همچنین برای تایید باید با شماره ای که دوستش دارید تماس بگیرید.

پیشگیری بهترین دفاع در برابر کلاهبرداری های شبیه سازی صوتی هوش مصنوعی است

گاهی اوقات، بهترین دفاع در برابر کلاهبرداری با فناوری پیشرفته، راه حلی با فناوری پایین است.

یک رمز عبور آفلاین ایجاد کنید که فقط برای عزیزان با خانواده و دوستانتان شناخته می شود. در صورت تماس دیوانه وار، استفاده از این رمز عبور می تواند راهی مطمئن برای تایید هویت تماس گیرنده باشد.

در نهایت، دور نگه داشتن اطلاعات خصوصی شما از رسانه های اجتماعی گام بزرگی در جهت حصول اطمینان از اینکه کلاهبرداران نمی توانند اطلاعات کافی برای ساختن یک روایت جمع آوری کنند، است. به یاد داشته باشید: اگر نمی خواهید همه آن را بشناسند، بهتر است آن را در شبکه های اجتماعی به اشتراک نگذارید.